The phrase «resistance to AI is futile» is often used in a playful or humorous context, drawing a reference to the famous line «Resistance is futile» from the science fiction series «Star Trek,» spoken by the Borg, a technologically advanced and assimilating civilization. However, in the context of AI, it is essential to clarify that resistance to AI is not futile, nor is it necessarily undesirable.

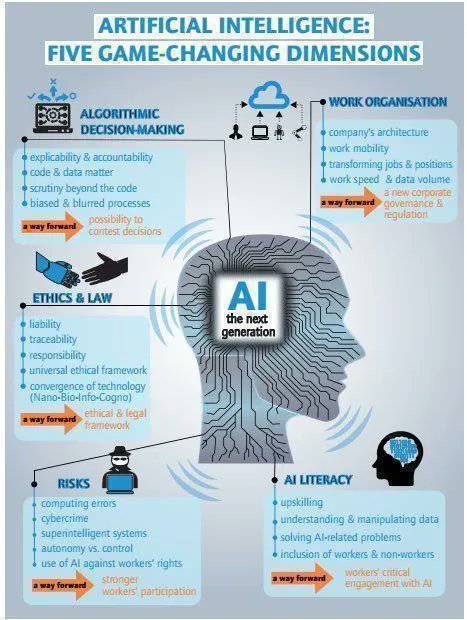

AI, as a transformative technology, is rapidly advancing and integrating into various aspects of our lives, from everyday applications to complex industries. There are both proponents and skeptics of AI, and discussions around its impact on society, ethics, and employment are ongoing.

Some reasons why people might consider resistance to AI difficult include:

- Pervasive Integration: AI is already integrated into numerous technologies and services. Its application is becoming increasingly widespread and deeply embedded in many industries, making it challenging to avoid its presence.

- Technological Advancement: AI technologies continue to evolve and improve, enhancing their capabilities and potential benefits in various fields.

- Economic and Industrial Advantages: AI adoption can provide significant advantages in productivity, efficiency, and innovation for businesses and industries.

- Automation and Labor Displacement: AI has the potential to automate certain tasks, leading to concerns about job displacement in certain sectors.

- Policy and Regulation Challenges: Formulating appropriate policies and regulations to govern AI’s ethical use and potential risks is complex and requires careful consideration.

However, it is essential to acknowledge that resistance, skepticism, and critical evaluation are vital elements of technological progress. Responsible development and deployment of AI require addressing potential challenges and ensuring that the technology benefits society as a whole.

As with any transformative technology, embracing AI should be a thoughtful and well-informed process, considering its implications on privacy, security, ethics, and equitable distribution of benefits. Encouraging open discussions, ethical considerations, and collaboration among stakeholders can help shape AI’s future in a manner that aligns with societal values and aspirations. Thus, while resistance might face challenges, active participation and critical engagement remain important aspects of AI’s integration into our lives.